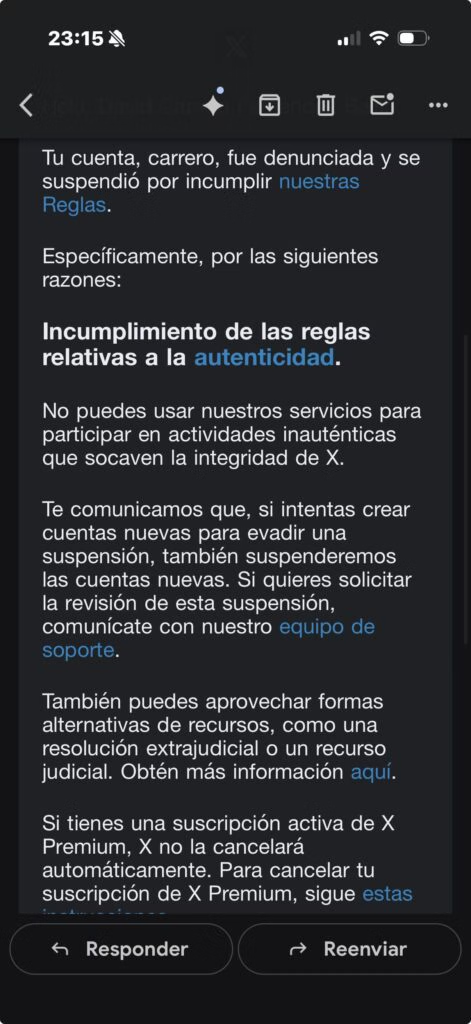

La plataforma X (antes Twitter) asegura combatir la inautenticidad y la automatización maliciosa. Sin embargo, su sistema de moderación automatizada está generando falsos positivos que golpean especialmente a cuentas reales y pequeñas. Uno de los últimos afectados es David Carrero Fernández-Baillo, empresario tecnológico español y suscriptor Premium, cuya cuenta @carrero fue suspendida por “incumplimiento de las reglas relativas a la autenticidad”. Su caso, documentado con la captura que acompaña este artículo, ilustra una paradoja incómoda: se castiga a usuarios legítimos mientras la red sigue inundada de spam, respuestas basura y cuentas efímeras que reaparecen tras cada barrido.

Un caso real: quién es el titular de @carrero

David Carrero es una figura conocida en el ecosistema tecnológico español. Cofundador y ejecutivo en Stackscale (infraestructura cloud en Europa) y business angel en proyectos como Acumbamail, Genially, Mailtrack, Product Hackers o Color Vivo, utiliza @carrero desde hace años para comunicarse a título personal y profesional.

Para cualquiera que desee comprobar su identidad, existen múltiples referencias públicas:

- Web corporativa de Stackscale: https://www.stackscale.com

- Sobre Stackscale: https://www.stackscale.com/es/sobre-nosotros/

- Perfil profesional: https://es.linkedin.com/in/dcarrero

- Entrevistas y menciones:

https://producthackers.com/es/podcast/episodio-19-infraestructura-cloud-david-carrero-stackscale/

https://www.youtube.com/watch?v=NQZ7YfMA9Zk

https://www.youtube.com/watch?v=YjY9ZrzjZ6I

https://elreferente.es/emprendedores/david-carrero/?refrc=1

https://www.youtube.com/watch?v=L08cx2kEuqM

https://www.elconfidencial.com/tecnologia/2013-05-28/los-mayores-fracasos-de-los-emprendedores-digitales-espanoles_766882/

Pese a ese rastro público, X le notificó que su cuenta había sido “denunciada” y suspendida por violar la política de autenticidad, además de advertirle sobre la prohibición de crear cuentas alternativas. Carrero asegura poder verificar identidad y titularidad sin inconvenientes (documentación oficial, selfie de verificación, dominio corporativo, recibos de la suscripción Premium) y solicita una revisión manual con identificación de la supuesta publicación o conducta infractora.

Moderación a escala: cuando el algoritmo falla

No es un secreto: las grandes plataformas dependen de sistemas automatizados para filtrar comportamientos inauténticos. ¿El problema? Cuando los modelos se calibran con un sesgo conservador, aparecen los falsos positivos. Y si la vía de apelación es opaca, lenta o impersonal, la sensación de indefensión es total.

Entre las señales que suelen activar filtros automáticos (y que pueden confundir a una cuenta legítima) están: patrones de publicación atípicos, picos de actividad desde nuevas ubicaciones o dispositivos, cambios rápidos de nombre o bio, enlaces constantes a dominios externos, alta interacción con tendencias polémicas o la participación en hilos con mucha presencia de bots. Son indicios, no pruebas. El reto consiste en distinguir entre un usuario real con actividad intensa y una granja de bots coordinada.

La otra cara: el spam que no se va

Mientras tanto, X continúa repleta de respuestas automatizadas, phishing, “chollos” falsos, cripto-estafas, contenido adulto camuflado y suplantaciones que drenan la conversación y deterioran la experiencia. El fenómeno se percibe especialmente en:

- Respuestas en masa a cuentas con alcance, con mensajes genéricos y enlaces acortados.

- Cuentas desechables que desaparecen tras un reporte y reaparecen con otra combinación de nombre y avatar.

- Secuestro de tendencias (hashtag hijacking) para arrastrar tráfico a webs dudosas.

La percepción ciudadana es clara: el spam persiste, pero un usuario con nombre y apellidos, trayectoria pública y suscripción de pago puede perder su cuenta de un día para otro, sin explicaciones concretas.

La paradoja Premium

Que una cuenta Premium sea suspendida por “inautenticidad” sin identificar la infracción concreta refuerza la idea de que el pago no garantiza un mejor debido proceso. Si la plataforma quiere que las suscripciones se perciban como un sello de confianza adicional, debería proveer una vía de apelación prioritaria y humana, con:

- Notificación detallada: enlace directo al tuit o acción supuestamente infractora y norma específica.

- Plazos claros de revisión y comunicación de estado.

- Verificación reforzada para titulares Premium que acrediten identidad y propiedad.

- Reversibilidad visible: si hubo error, restituir con disculpa y registro para evitar reincidencias.

Qué pide el afectado y por qué tiene sentido

Carrero solicita una revisión manual y, si existiese una publicación cuestionable, la identificación exacta para corregir inmediatamente cualquier fallo. Es una petición razonable por dos motivos:

- Proporcionalidad: no es lo mismo retirar una pieza de contenido dudoso que suspender toda la cuenta.

- Transparencia: el usuario debe conocer la regla concreta y el hecho que la vulnera.

Además, el afectado no ha creado cuentas alternativas —algo que la propia notificación de X prohíbe expresamente— y se muestra dispuesto a acreditar identidad y titularidad por las vías que la plataforma establezca.

Qué debería mejorar X

Para reducir falsos positivos y recuperar la confianza de la comunidad, X podría:

- Publicar criterios de referencia (a alto nivel) sobre señales de inautenticidad y ejemplos fronterizos.

- Mejorar el canal de apelaciones con atención humana verificable, especialmente para cuentas con rastro público.

- Incorporar peso reputacional externo: dominios corporativos verificados, presencia en medios, referencias cruzadas, etc.

- Establecer auditorías internas de los modelos de detección y revisiones de sesgo.

- Priorizar el “spam duro” (phishing, estafas, malware) con equipos especializados y verificación de reincidencia por IP/huella.

Qué pueden hacer los usuarios mientras tanto

Mientras llega una respuesta, hay acciones que mitigan el daño y documentan el caso:

- Registrar evidencia: capturas de la notificación (como la que se muestra en este artículo) y cronología de hechos.

- Formular la apelación con datos verificables (identidad, dominio corporativo, entrevistas) y un tono respetuoso.

- Evitar crear cuentas espejo: puede empeorar el expediente y retrasar la revisión.

- Comunicar desde cuentas corporativas o de socios para dar visibilidad y aportar contexto público.

- Mantener un repositorio con enlaces de verificación (web, LinkedIn, entrevistas) y —si procede— pruebas de suscripción.

Conclusión

La lucha contra la inautenticidad es necesaria. Pero cuando la balanza se inclina hacia la suspensión preventiva sin explicaciones, la plataforma castiga a quienes sostienen la conversación: personas reales que aportan contenido y reputación. El caso de @carrero no denuncia una política en sí, sino su aplicación opaca. X tiene la oportunidad de convertir un error en un gesto de confianza: revisar, explicar y restituir. Y, de paso, apretar de verdad contra el spam que todos vemos cada día.

Preguntas frecuentes

¿Por qué X puede suspender una cuenta por “inautenticidad”?

Porque detecte señales que interpreta como automatización, suplantación o manipulación coordinada. Son modelos estadísticos: aciertan a gran escala, pero pueden fallar con usuarios reales y nichos pequeños.

¿Qué conviene incluir en una apelación?

Identidad verificable (documento, dominio corporativo, enlaces públicos), historial de uso de la cuenta y una solicitud explícita de que señalen el tuit/acción concreta y la norma aplicada. Mantener un tono profesional ayuda.

¿Pagar Premium evita estos problemas?

No. La suscripción puede facilitar la verificación, pero no sustituye la revisión humana ni garantiza que un algoritmo no señale la cuenta por error.

¿Cómo distinguirse de los bots para no caer en falsos positivos?

Evitar cambios bruscos de identidad, no usar automatismos opacos, cuidar el uso de acortadores y enlaces, activar 2FA, verificar dominio propio y mantener una presencia pública coherente en la red (web, perfiles profesionales, menciones en medios).

Nota: este artículo incluye información y una captura de pantalla facilitada por el afectado. Las direcciones de correo personales no se publican por privacidad.